DAGNetwork

(권장되지 않음) 딥러닝을 위한 DAG(유방향 비순환 그래프) 신경망

설명

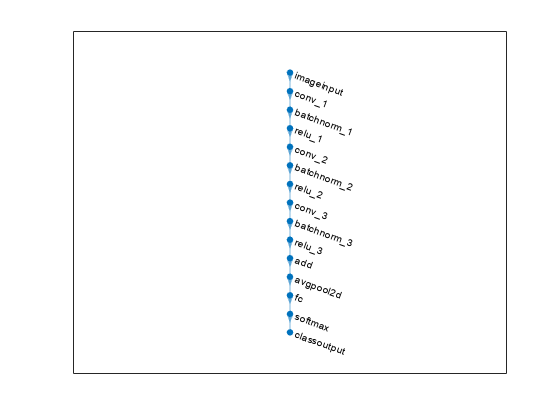

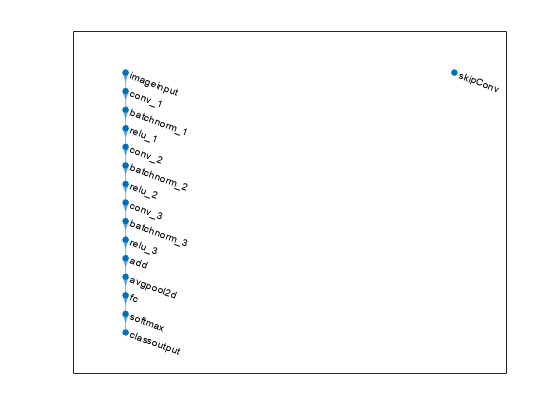

DAG 신경망은 딥러닝을 위한 신경망입니다. 이 신경망의 계층은 유방향 비순환 그래프로 배열됩니다. DAG 신경망에서는 계층이 여러 계층으로부터 입력을 가질 수 있고 여러 계층으로 출력을 보낼 수 있는 보다 복잡한 아키텍처를 가질 수 있습니다.

생성

DAGNetwork 객체를 만드는 방법에는 여러 가지가 있습니다.

squeezenet,googlenet,resnet50,resnet101또는inceptionv3과 같은 사전 훈련된 신경망을 불러옵니다. 예제는 SqueezeNet 신경망 불러오기 항목을 참조하십시오. 사전 훈련된 신경망에 대한 자세한 내용은 사전 훈련된 심층 신경망 항목을 참조하십시오.trainNetwork를 사용하여 신경망을 훈련시키거나 미세 조정합니다.TensorFlow™-Keras, TensorFlow 2, Caffe 또는 ONNX™(Open Neural Network Exchange) 모델 형식에서 사전 훈련된 신경망을 가져옵니다.

Keras 모델에는

importKerasNetwork를 사용하십시오. 예제는 Keras 신경망을 가져오고 플로팅하기 항목을 참조하십시오.저장된 모델 형식의 TensorFlow 모델에는

importTensorFlowNetwork를 사용하십시오. 예제는 Import TensorFlow Network as DAGNetwork to Classify Image 항목을 참조하십시오.Caffe 모델에는

importCaffeNetwork를 사용하십시오. 예제는 Caffe 신경망 가져오기 항목을 참조하십시오.ONNX 모델에는

importONNXNetwork를 사용하십시오. 예제는 Import ONNX Network as DAGNetwork 항목을 참조하십시오.

assembleNetwork함수를 사용하여, 사전 훈련된 계층에서 딥러닝 신경망을 조합합니다.

참고

기타 사전 훈련된 신경망에 대해 자세히 알아보려면 사전 훈련된 심층 신경망 항목을 참조하십시오.

속성

객체 함수

activations | (권장되지 않음) 딥러닝 신경망 계층 활성화 계산 |

classify | (권장되지 않음) 훈련된 딥러닝 신경망을 사용하여 데이터 분류 |

predict | (권장되지 않음) 훈련된 딥러닝 신경망을 사용하여 응답 변수 예측 |

plot | 신경망 아키텍처 플로팅 |

predictAndUpdateState | (권장되지 않음) 훈련된 순환 신경망을 사용하여 응답 변수 예측 및 신경망 상태 업데이트 |

classifyAndUpdateState | (권장되지 않음) 훈련된 순환 신경망을 사용하여 데이터 분류 및 신경망 상태 업데이트 |

resetState | 신경망의 상태 파라미터 재설정 |