DDPG 에이전트를 사용하여 탱크의 수위 제어하기

이 예제에서는 watertank Simulink® 모델의 PI 제어기를 강화 학습 DDPG(심층 결정적 정책 경사) 에이전트로 변환하는 방법을 보여줍니다. MATLAB®에서 DDPG 에이전트를 훈련시키는 예제는 Compare DDPG Agent to LQR Controller 항목을 참조하십시오.

재현이 가능하도록 난수 스트림 고정하기

예제 코드의 다양한 단계에서 난수 계산이 포함될 수 있습니다. 예제 코드에 있는 다양한 섹션의 시작 부분에서 난수 스트림을 고정하면 매 실행 시에 섹션의 난수열이 유지되며 결과를 재현할 가능성이 높아집니다. 자세한 내용은 결과 재현성 항목을 참조하십시오.

시드값 0과 난수 알고리즘인 메르센 트위스터를 사용하여 난수 스트림을 고정합니다. 난수 생성에 사용되는 시드값을 제어하는 방법에 대한 자세한 내용은 rng 항목을 참조하십시오.

previousRngState = rng(0,"twister")previousRngState = struct with fields:

Type: 'twister'

Seed: 0

State: [625×1 uint32]

출력값 previousRngState는 스트림의 이전 상태에 대한 정보를 포함하는 구조체입니다. 이 예제의 끝부분에서 그 상태를 복원할 것입니다.

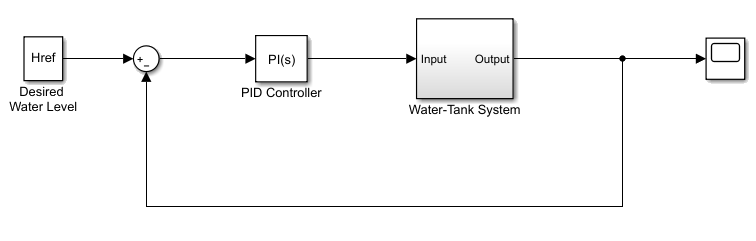

물탱크 모델

이 예제의 원래 모델은 물탱크 모델입니다. 여기서 목표는 탱크에 있는 물의 수위를 제어하는 것입니다. 물탱크 모델에 대한 자세한 내용은 watertank Simulink 모델 (Simulink Control Design) 항목을 참조하십시오.

다음과 같이 변경하여 원래 모델을 수정합니다.

PID 제어기를 삭제합니다.

RL Agent 블록을 삽입합니다.

관측값 벡터 를 연결합니다. 여기서 는 탱크의 수위이고 이며 은 기준 높이입니다.

보상 을 설정합니다.

또는 인 경우 시뮬레이션이 중지되도록 종료 신호를 구성합니다.

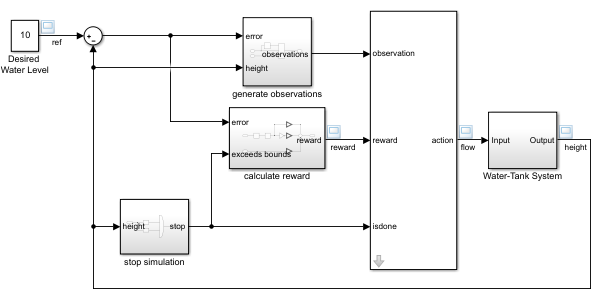

결과로 생성되는 모델은 rlwatertank.slx입니다. 이 모델과 변경 사항에 대한 자세한 내용은 사용자 지정 Simulink 환경 만들기 항목을 참조하십시오.

open_system("rlwatertank")

환경 만들기

환경 모델을 만드는 과정에는 다음을 정의하는 작업이 포함됩니다.

에이전트가 환경과 상호 작용하는 데 사용하는 행동 및 관측값 신호. 자세한 내용은

rlNumericSpec항목과rlFiniteSetSpec항목을 참조하십시오.에이전트가 성공을 측정하는 데 사용하는 보상 신호. 자세한 내용은 Define Observation and Reward Signals in Custom Environments 항목을 참조하십시오.

관측값 사양 obsInfo와 행동 사양 actInfo를 정의합니다.

% Observation info obsInfo = rlNumericSpec([3 1],... LowerLimit=[-inf -inf 0 ]',... UpperLimit=[ inf inf inf]'); % Name and description are optional and not used % by the software obsInfo.Name = "observations"; obsInfo.Description = "integrated error, error," + ... " and measured height"; % Action info actInfo = rlNumericSpec([1 1]); actInfo.Name = "flow";

환경 객체를 만듭니다.

env = rlSimulinkEnv("rlwatertank","rlwatertank/RL Agent",... obsInfo,actInfo);

모델의 기준 값을 무작위로 정해 주는 사용자 지정 재설정 함수를 설정합니다. localResetFcn 함수는 이 예제의 끝부분에 제공됩니다.

env.ResetFcn = @localResetFcn;

에이전트 샘플 시간 Ts와 시뮬레이션 시간 Tf를 초 단위로 지정합니다.

Ts = 1.0; Tf = 200;

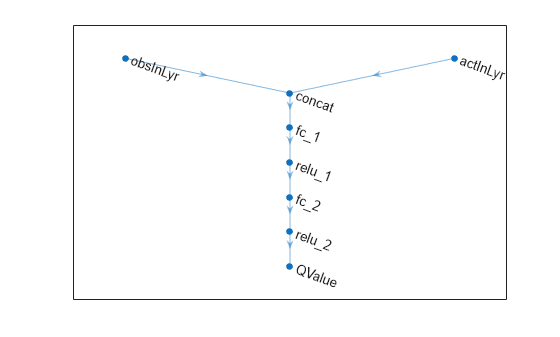

크리틱 만들기

DDPG 에이전트는 파라미터화된 Q-값 함수 근사기를 사용하여 정책의 값을 추정합니다. Q-값 함수 크리틱은 현재 관측값과 행동을 입력값으로 받고 single형 스칼라를 출력값(현재 관측값에 해당하는 상태로부터 행동을 받고 이후 정책을 따랐을 때 추정되는 감가된 누적 장기 보상)으로 반환합니다.

크리틱 내에서 파라미터화된 Q-값 함수를 모델링하려면 두 개의 입력 계층(obsInfo로 지정된 대로 관측값 채널에 대한 입력 계층 및 actInfo로 지정된 대로 행동 채널에 대한 입력 계층)과 (스칼라 값을 반환하는) 하나의 출력 계층을 갖는 신경망을 사용하십시오.

각 신경망 경로를 layer 객체로 구성된 배열로 정의합니다. 각 경로의 입력 계층과 출력 계층에 이름을 할당합니다. 이러한 이름을 사용하면 경로를 연결한 다음 나중에 신경망 입력 계층 및 출력 계층을 적절한 환경 채널과 명시적으로 연결할 수 있습니다. obsInfo 사양과 actInfo 사양에서 관측값 공간과 행동 공간의 차원을 얻습니다.

% Observation path obsPath = featureInputLayer(obsInfo.Dimension(1), ... Name="obsInLyr"); % Action path actPath = featureInputLayer(actInfo.Dimension(1), ... Name="actInLyr"); % Common path commonPath = [ concatenationLayer(1,2,Name="concat") fullyConnectedLayer(25) reluLayer() fullyConnectedLayer(25) reluLayer() fullyConnectedLayer(1,Name="QValue") ]; % Create the network object and add the layers criticNet = dlnetwork(); criticNet = addLayers(criticNet,obsPath); criticNet = addLayers(criticNet,actPath); criticNet = addLayers(criticNet,commonPath); % Connect the layers criticNet = connectLayers(criticNet, ... "obsInLyr","concat/in1"); criticNet = connectLayers(criticNet, ... "actInLyr","concat/in2");

크리틱 신경망 구성을 표시합니다.

plot(criticNet)

dlnetwork 객체를 초기화하고 해당 속성을 요약합니다. 크리틱 신경망의 초기 파라미터가 난수 값으로 초기화됩니다. 신경망이 항상 동일한 파라미터 값으로 초기화되도록 난수 스트림을 고정합니다.

rng(0,"twister");

criticNet = initialize(criticNet);

summary(criticNet) Initialized: true

Number of learnables: 801

Inputs:

1 'obsInLyr' 3 features

2 'actInLyr' 1 features

지정된 심층 신경망, 환경 사양 객체, 그리고 관측값 채널 및 행동 채널과 연결할 신경망 입력의 이름을 사용하여 크리틱 근사기 객체를 만듭니다.

critic = rlQValueFunction(criticNet, ... obsInfo,actInfo, ... ObservationInputNames="obsInLyr", ... ActionInputNames="actInLyr");

Q-값 함수 객체에 대한 자세한 내용은 rlQValueFunction 항목을 참조하십시오.

임의의 입력 관측값과 행동을 사용하여 크리틱을 확인합니다.

getValue(critic, ... {rand(obsInfo.Dimension)}, ... {rand(actInfo.Dimension)})

ans = single

-0.4320

크리틱을 만드는 방법에 대한 자세한 내용은 Create Policies and Value Functions 항목을 참조하십시오.

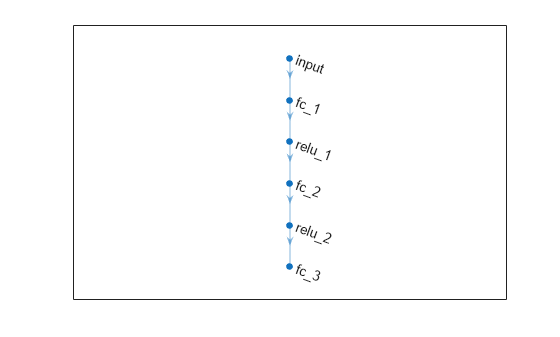

액터 만들기

DDPG 에이전트는 연속 행동 공간에 대해 연속 결정적 액터가 학습한 파라미터화된 결정적 정책을 사용합니다.

연속 결정적 액터는 연속 행동 공간에 대한 파라미터화된 결정적 정책을 구현합니다. 이 액터는 현재 관측값을 입력값으로 받고 관측값의 결정적 함수인 행동을 출력값으로 반환합니다.

액터 내에서 파라미터화된 정책을 모델링하려면 (obsInfo로 지정된 대로 환경 관측값 채널의 내용을 받는) 하나의 입력 계층과 (actInfo로 지정된 대로 환경 행동 채널에 행동을 반환하는) 하나의 출력 계층을 갖는 신경망을 사용하십시오.

신경망을 layer 객체로 구성된 배열로 정의합니다.

actorNet = [

featureInputLayer(obsInfo.Dimension(1))

fullyConnectedLayer(25)

reluLayer()

fullyConnectedLayer(25)

reluLayer()

fullyConnectedLayer(actInfo.Dimension(1))

];신경망을 dlnetwork 객체로 변환하고 해당 속성을 요약합니다. 액터 신경망의 초기 파라미터가 난수 값으로 초기화됩니다. 신경망이 항상 동일한 파라미터 값으로 초기화되도록 난수 스트림을 고정합니다.

rng(0,"twister");

actorNet = dlnetwork(actorNet);

summary(actorNet) Initialized: true

Number of learnables: 776

Inputs:

1 'input' 3 features

액터 신경망 구성을 표시합니다.

plot(actorNet)

지정된 심층 신경망, 환경 사양 객체, 그리고 관측값 채널과 연결할 신경망 입력의 이름을 사용하여 액터 근사기 객체를 만듭니다.

actor = rlContinuousDeterministicActor(actorNet,obsInfo,actInfo);

자세한 내용은 rlContinuousDeterministicActor 항목을 참조하십시오.

임의의 입력 관측값을 사용하여 액터를 확인합니다.

getAction(actor,{rand(obsInfo.Dimension)})ans = 1×1 cell array

{[-0.1002]}

크리틱을 만드는 방법에 대한 자세한 내용은 Create Policies and Value Functions 항목을 참조하십시오.

DDPG 에이전트 만들기

지정된 액터와 크리틱 근사기 객체를 사용하여 DDPG 에이전트를 만듭니다.

agent = rlDDPGAgent(actor,critic);

자세한 내용은 rlDDPGAgent 항목을 참조하십시오.

점 표기법을 사용하여 에이전트, 액터, 크리틱에 대한 옵션을 지정합니다. 이 훈련의 경우 다음이 적용됩니다.

경험을 저장하기 위해 최대 1e6의 용량을 갖는 경험 버퍼를 사용합니다. 경험 버퍼가 클수록 다양한 경험 세트를 저장할 수 있습니다.

액터와 크리틱 학습률을 각각 1e-4와 1e-3으로 지정합니다. 학습률이 높으면 대대적인 업데이트가 야기되어 발산이 발생할 수 있으며, 값이 낮으면 최적점에 도달하기까지 많은 업데이트가 필요할 수 있습니다.

기울기 임계값을 1로 지정하여 기울기를 자릅니다. 기울기를 자르면 훈련 안정성을 높일 수 있습니다.

400개 경험의 미니 배치를 사용합니다. 미니 배치 크기가 이보다 작으면 계산이 효율적이지만 훈련 시 변동성이 생길 수 있습니다. 반대로 미니 배치 크기가 이보다 크면 훈련이 안정되지만 메모리가 더 많이 필요할 수 있습니다.

1.0의 감가 인자는 장기 보상을 선호합니다.

샘플 시간 Ts=1.0초가 에이전트에 할당됩니다.

agent.AgentOptions.SampleTime = Ts; agent.AgentOptions.DiscountFactor = 1.0; agent.AgentOptions.MiniBatchSize = 400; agent.AgentOptions.ExperienceBufferLength = 1e6; actorOpts = rlOptimizerOptions( ... LearnRate=1e-4, ... GradientThreshold=1); criticOpts = rlOptimizerOptions( ... LearnRate=1e-3, ... GradientThreshold=1); agent.AgentOptions.ActorOptimizerOptions = actorOpts; agent.AgentOptions.CriticOptimizerOptions = criticOpts;

이 예제의 DDPG 에이전트는 탐색에 Ornstein-Uhlenbeck(OU) 잡음 모델을 사용합니다. 잡음 모델의 경우 다음이 적용됩니다.

훈련 중 탐색을 개선하기 위해 표준편차 값을 0.3으로 지정합니다.

표준편차에 1e-5의 감쇠율을 지정합니다. 감쇠로 인해 훈련이 진행됨에 따라 탐색이 점차적으로 감소합니다.

agent.AgentOptions.NoiseOptions.StandardDeviation = 0.3; agent.AgentOptions.NoiseOptions.StandardDeviationDecayRate = 1e-5;

또는 rlDDPGAgentOptions 객체를 사용하여 에이전트 옵션을 지정할 수 있습니다.

임의의 입력 관측값을 사용하여 에이전트를 확인합니다.

getAction(agent,{rand(obsInfo.Dimension)})ans = 1×1 cell array

{[0.1015]}

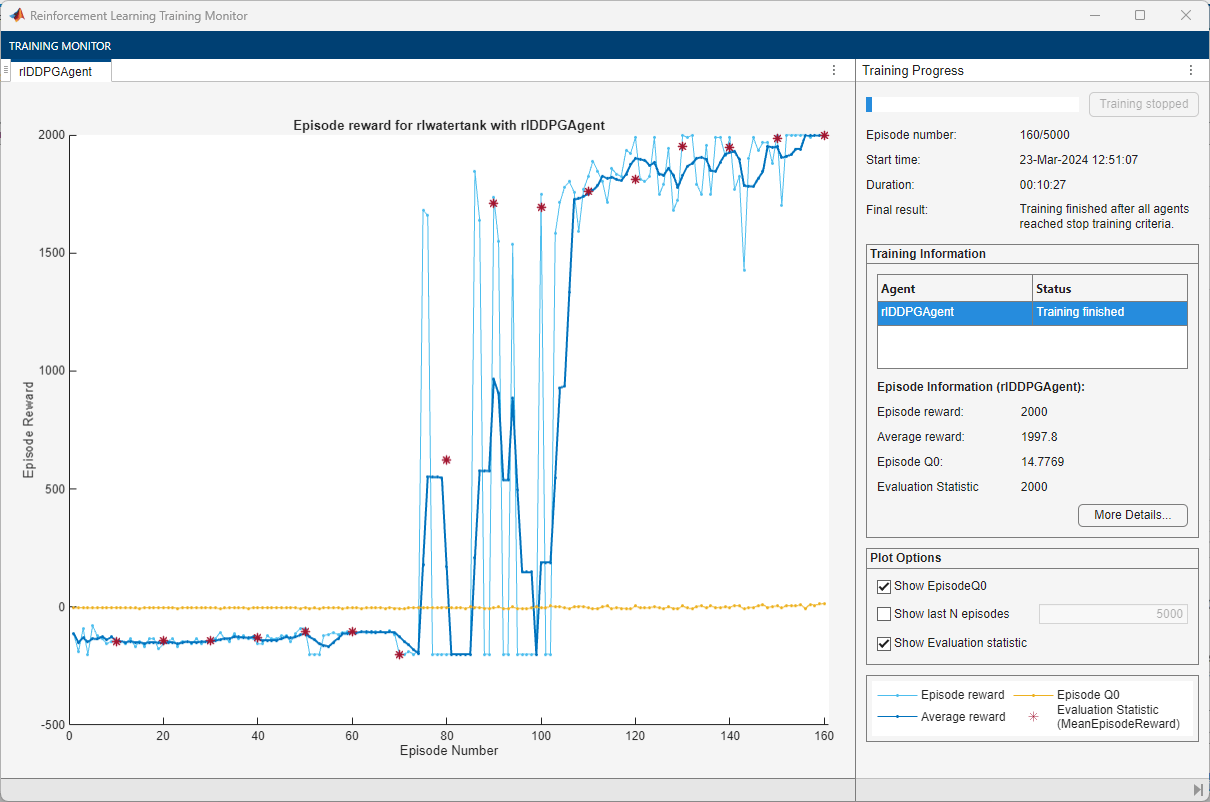

에이전트 훈련시키기

에이전트를 훈련시키려면 먼저 훈련 옵션을 지정하십시오. 이 예제에서는 다음 옵션을 사용합니다.

최대 5000개의 에피소드에 대해 각 훈련을 실행합니다. 각 에피소드가 최대

ceil(Tf/Ts)개(즉, 200개)의 시간 스텝만큼 지속되도록 지정합니다.강화 학습 훈련 모니터 대화 상자에 훈련 진행 상황을 표시하고(

Plots옵션 설정) 명령줄 표시를 비활성화합니다(Verbose옵션을false로 설정).훈련 에피소드 10개마다 그리디 정책 성능을 평가하고, 5회 시뮬레이션의 누적 보상에 대한 평균값을 계산합니다.

평가 점수가 2000에 도달하면 훈련을 중지합니다. 이 시점에서 에이전트는 탱크에 있는 물의 수위를 제어할 수 있습니다.

훈련 옵션에 대한 자세한 내용은 rlTrainingOptions 항목을 참조하십시오.

% training options trainOpts = rlTrainingOptions(... MaxEpisodes=5000, ... MaxStepsPerEpisode=ceil(Tf/Ts), ... Plots="training-progress", ... Verbose=false, ... StopTrainingCriteria="EvaluationStatistic", ... StopTrainingValue=2000); % agent evaluator evl = rlEvaluator(EvaluationFrequency=10,NumEpisodes=5);

재현이 가능하도록 난수 스트림을 고정합니다.

rng(0,"twister");train 함수를 사용하여 에이전트를 훈련시킵니다. 훈련은 완료하는 데 수 분이 소요되는 계산 집약적인 절차입니다. 이 예제를 실행하는 동안 시간을 절약하려면 doTraining을 false로 설정하여 사전 훈련된 에이전트를 불러오십시오. 에이전트를 직접 훈련시키려면 doTraining을 true로 설정하십시오.

doTraining =false; if doTraining % Train the agent. trainingStats = train(agent,env,trainOpts,Evaluator=evl); else % Load the pretrained agent for the example. load("WaterTankDDPG.mat","agent") end

훈련된 에이전트 검증하기

재현이 가능하도록 난수 스트림을 고정합니다.

rng(0,"twister");환경 내에서 에이전트를 시뮬레이션하고 경험을 출력값으로 반환합니다.

simOpts = rlSimulationOptions( ... MaxSteps=ceil(Tf/Ts), ... StopOnError="on"); experiences = sim(env,agent,simOpts);

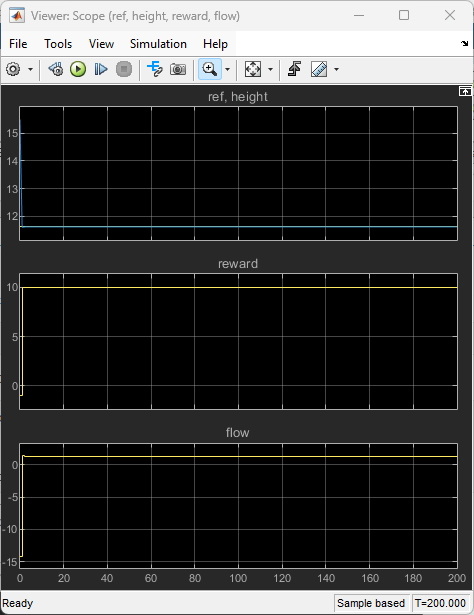

Simulink 모델의 Scope 블록을 사용하여 폐루프 시스템의 성능을 표시합니다. 에이전트는 5초 내에 기준 신호를 추종합니다.

previousRngState에 저장된 정보를 사용하여 난수 스트림을 복원합니다.

rng(previousRngState);

로컬 재설정 함수

function in = localResetFcn(in) % Randomize reference signal blk = sprintf("rlwatertank/Desired \nWater Level"); h = 3*randn + 10; while h <= 0 || h >= 20 h = 3*randn + 10; end in = setBlockParameter(in,blk,Value=num2str(h)); % Randomize initial height h = 3*randn + 10; while h <= 0 || h >= 20 h = 3*randn + 10; end blk = "rlwatertank/Water-Tank System/H"; in = setBlockParameter(in,blk,InitialCondition=num2str(h)); end

참고 항목

함수

객체

rlFiniteSetSpec|rlNumericSpec|rlQValueFunction|rlContinuousDeterministicActor|rlDDPGAgent|rlDDPGAgentOptions|rlTrainingOptions|rlSimulationOptions

도움말 항목

- Compare DDPG Agent to LQR Controller

- 이산 카트-폴 시스템의 균형을 유지하도록 DQN 에이전트 훈련시키기

- 진자가 위쪽으로 똑바로 서서 균형을 유지하도록 DQN 에이전트 훈련시키기

- 강화 학습을 사용하여 PI 제어기 조정하기

- Train Reinforcement Learning Agents to Control Quanser QUBE Pendulum

- watertank Simulink 모델 (Simulink Control Design)

- 물탱크 강화 학습 환경 모델

- 제어 시스템 응용 사례를 위한 강화 학습

- 사용자 지정 Simulink 환경 만들기

- Define Observation and Reward Signals in Custom Environments

- 강화 학습 에이전트

- 강화 학습 에이전트 훈련시키기