연산

사용자 지정 딥러닝 함수 개발

대부분의 작업에서 내장 계층을 사용할 수 있습니다. 작업에 필요한 내장 계층이 없는 경우 자신만의 고유한 사용자 지정 계층을 정의할 수 있습니다. 학습 가능한 파라미터와 상태 파라미터를 포함하는 사용자 지정 계층을 정의할 수 있습니다. 사용자 지정 계층을 정의한 후에는 이 계층이 유효하고, GPU와 호환되며, 올바르게 정의된 기울기를 출력하는지 확인할 수 있습니다. 자세한 내용은 사용자 지정 딥러닝 계층 정의하기 항목을 참조하십시오. 지원되는 계층 목록은 딥러닝 계층 목록 항목을 참조하십시오.

딥러닝 연산을 사용하여 사용자 지정 계층, 훈련 루프 및 모델 함수에 대한 MATLAB® 코드를 개발합니다.

함수

도움말 항목

자동 미분

- Automatic Differentiation Background

Learn how automatic differentiation works. - Use Automatic Differentiation In Deep Learning Toolbox

How to use automatic differentiation in deep learning. - List of Functions with dlarray Support

View the list of functions that supportdlarrayobjects. - Define Custom Deep Learning Operations

Learn how to define custom deep learning operation. (R2024a 이후) - Specify Custom Operation Backward Function

This example shows how to define the SReLU operation as a differentiable function and specify a custom backward function. (R2024a 이후) - Train Model Using Custom Backward Function

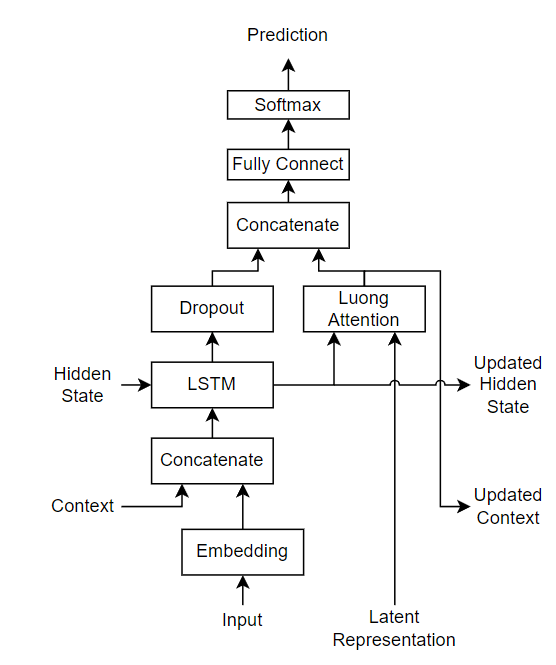

This example shows how to train a deep learning model that contains an operation with a custom backward function. - Create Bidirectional LSTM (BiLSTM) Function

This example shows how to create a bidirectional long-short term memory (BiLSTM) function for custom deep learning functions. (R2023b 이후)

모델 함수

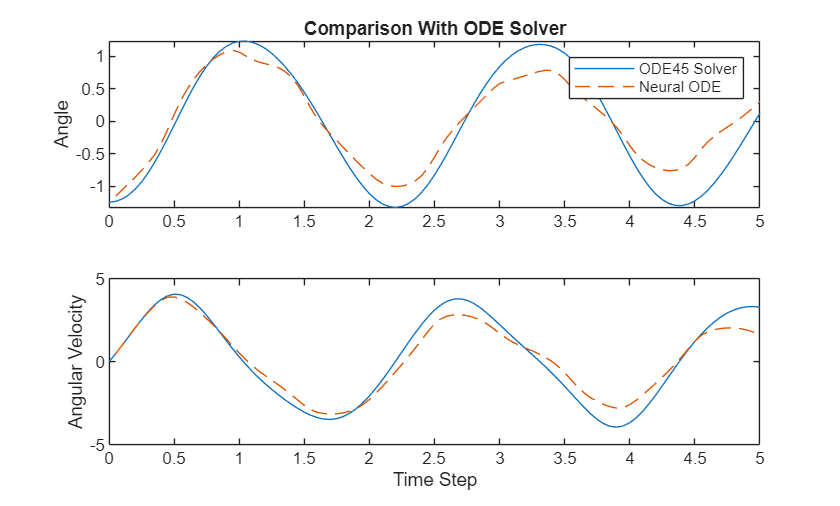

- Train Network Using Model Function

This example shows how to create and train a deep learning network by using functions rather than a layer graph or adlnetwork. - Update Batch Normalization Statistics Using Model Function

This example shows how to update the network state in a network defined as a function. - Make Predictions Using Model Function

This example shows how to make predictions using a model function by splitting data into mini-batches. - Initialize Learnable Parameters for Model Function

Learn how to initialize learnable parameters for custom training loops using a model function.

딥러닝 함수 가속

- Deep Learning Function Acceleration

Accelerate model functions and model loss functions by caching and reusing traces. - Accelerate Custom Training Loop Functions

This example shows how to accelerate deep learning custom training loop and prediction functions. - 가속화된 딥러닝 함수의 출력값 검사하기

이 예제에서는 가속화된 함수의 출력값이 기본 함수의 출력값과 일치하는지 검사하는 방법을 보여줍니다. - Evaluate Performance of Accelerated Deep Learning Function

This example shows how to evaluate the performance gains of using an accelerated function.