분산 배열

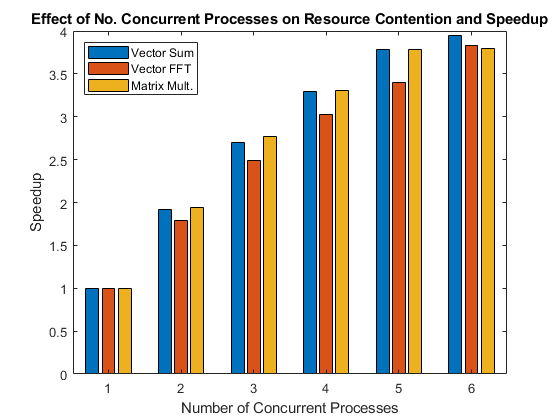

분산 배열과 동시 실행을 사용하여 빅데이터 세트를 병렬로 분석합니다

Parallel Computing Toolbox™는 큰 배열을 여러 MATLAB® 워커에 걸쳐 분할할 수 있도록 분산 배열을 지원합니다. 사용자는 전체 배열을 단일 개체로 보고 연산을 수행하지만, 워커는 배열의 일부에 대해서만 연산을 수행하고 필요한 경우 워커 간에 자동으로 데이터를 전송합니다. 워커 간 통신이 용이하도록 단일 프로그램 다중 데이터(spmd) 언어 구문에서 동시 실행이 지원됩니다. 분산 지원 행렬 연산과 함수를 사용하여 이러한 배열을 추가적으로 수정하지 않고 직접 사용할 수 있습니다. Parallel Computing Toolbox에서 분산 배열을 사용하면 클러스터의 결합된 메모리를 사용하여 빅데이터 애플리케이션을 실행할 수 있습니다.

함수

클래스

도움말 항목

분산 배열

- Create and Use Distributed Arrays

When your data array is too big to fit into the memory of a single machine, you can create adistributedarray. - 분산 배열을 사용하여 MATLAB 함수 실행

분산 배열에 대한 연산을 수행하는 MATLAB 함수입니다. - Distributing Arrays to Parallel Workers

Usedatastoreordistributedto create distributed arrays and partition the data among your workers. - Nondistributed Versus Distributed Arrays

Describes the various types of arrays used in communicating jobs. - Use Distributed Arrays to Solve Systems of Linear Equations with Direct Methods

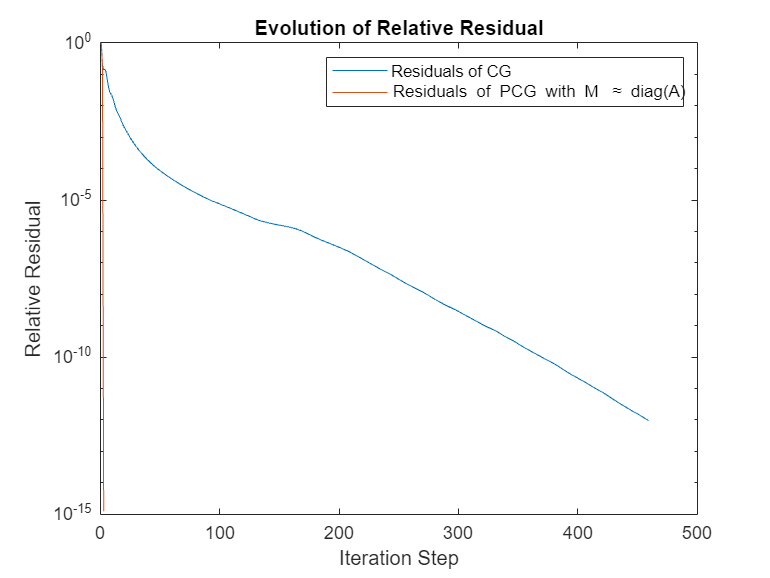

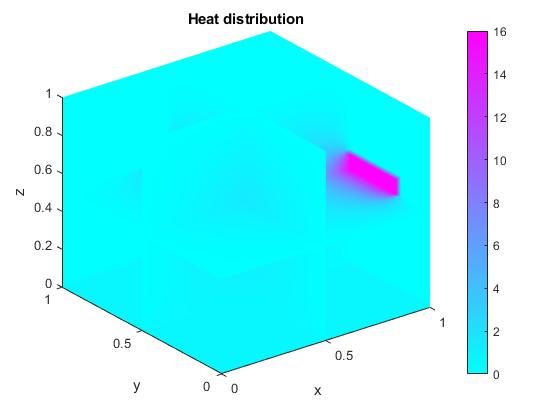

This example shows how to solve a system of linear equations of the form in parallel with a direct method using distributed arrays. - Use Distributed Arrays to Solve Systems of Linear Equations with Iterative Methods

For large-scale mathematical computations, iterative methods can be more efficient than direct methods. - Resolve Error: Client Lost Connection to Worker

Troubleshoot lost connection to worker error when running code on parallel pools. (R2026a 이후)

단일 프로그램 다중 데이터(spmd)

- Choose Between spmd, parfor, and parfeval

Compare and contrastspmdagainst other parallel computing functionality such asparforandparfeval. - 다중 데이터 세트에서 단일 프로그램 실행하기

spmd문을 사용하여 여러 데이터셋에서 동일한 코드를 실행하고 공동분산 배열을 제어합니다. - Working with Codistributed Arrays

Describes how to use codistributed arrays for calculation. - Access Worker Variables with Composites

Composite objects in the MATLAB client session let you directly access data values on the workers. - Use Message Passing to Estimate Pi

This example shows the basics of working with message passing inspmdstatements, similar to collective operations in the Message Passing Interface (MPI) specification. - Train Network in Parallel with Custom Training Loop (Deep Learning Toolbox)

This example shows how to set up a custom training loop to train a network in parallel. - Looping over a Distributed Range (for-drange)

Describes how to program afor-loop with codistributed arrays. - Use spmdReduce to Achieve MPI_Allreduce Functionality

This example shows how to perform reduction operations, such as additions, finding products, minimums, or maximums, across all workers in a parallel pool. - Communicate Between Workers in SPMD Computations

Exchange data between workers usingspmdSendandspmdReceive, similar to point-to-point communication in the Message Passing Interface (MPI) standard. - Fit Distributed Logistic Regression Using drange

This example shows how to use distributed arrays andfor-drange-loops to implement logistic regression on large data. - Compute Parallel Prefix Scans with SPMD Computations

Implement a reusable, scalable, SPMD based prefix scan using a parallel workers. - 원격 데이터로 작업하기

Amazon S3™, Azure® Blob Storage, HDFS™에 있는 원격 데이터로 작업합니다.