가지치기

1차 테일러 근사를 사용하여 신경망 필터 가지치기, 학습 가능한 파라미터 개수 줄이기

1차 테일러 근사를 사용하여 컨벌루션 계층에서 필터를 가지치기합니다. 그런 다음 가지치기된 신경망에서 C/C++ 또는 CUDA® 코드를 생성할 수 있습니다.

Deep Learning Toolbox™ Model Compression Library에서 사용 가능한 압축 기법에 대한 자세한 개요는 Reduce Memory Footprint of Deep Neural Networks 항목을 참조하십시오.

함수

taylorPrunableNetwork | Neural network suitable for compression using Taylor pruning (R2022a 이후) |

forward | Compute deep learning network output for training |

predict | 추론에 사용할 딥러닝 신경망 출력값 계산 |

updatePrunables | Remove filters from prunable layers based on importance scores (R2022a 이후) |

updateScore | Compute and accumulate Taylor-based importance scores for pruning (R2022a 이후) |

도움말 항목

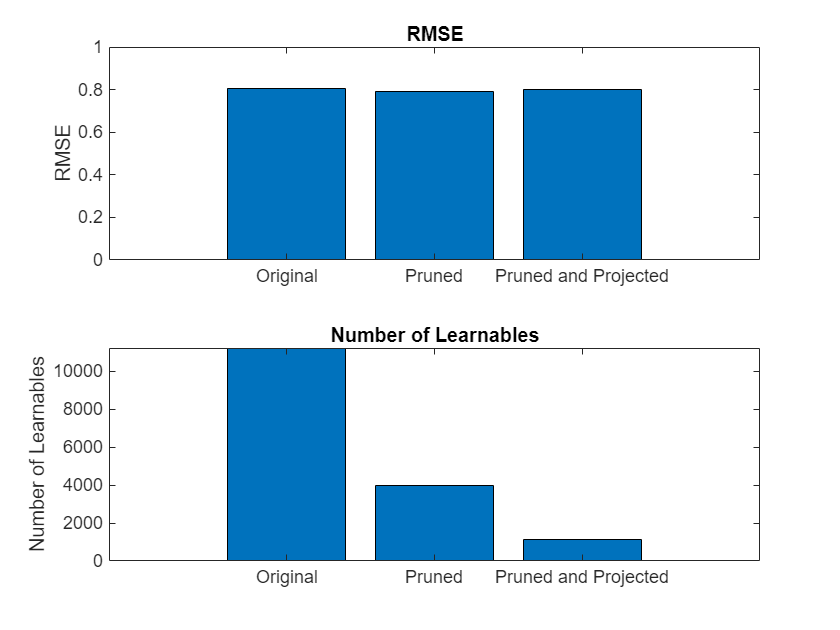

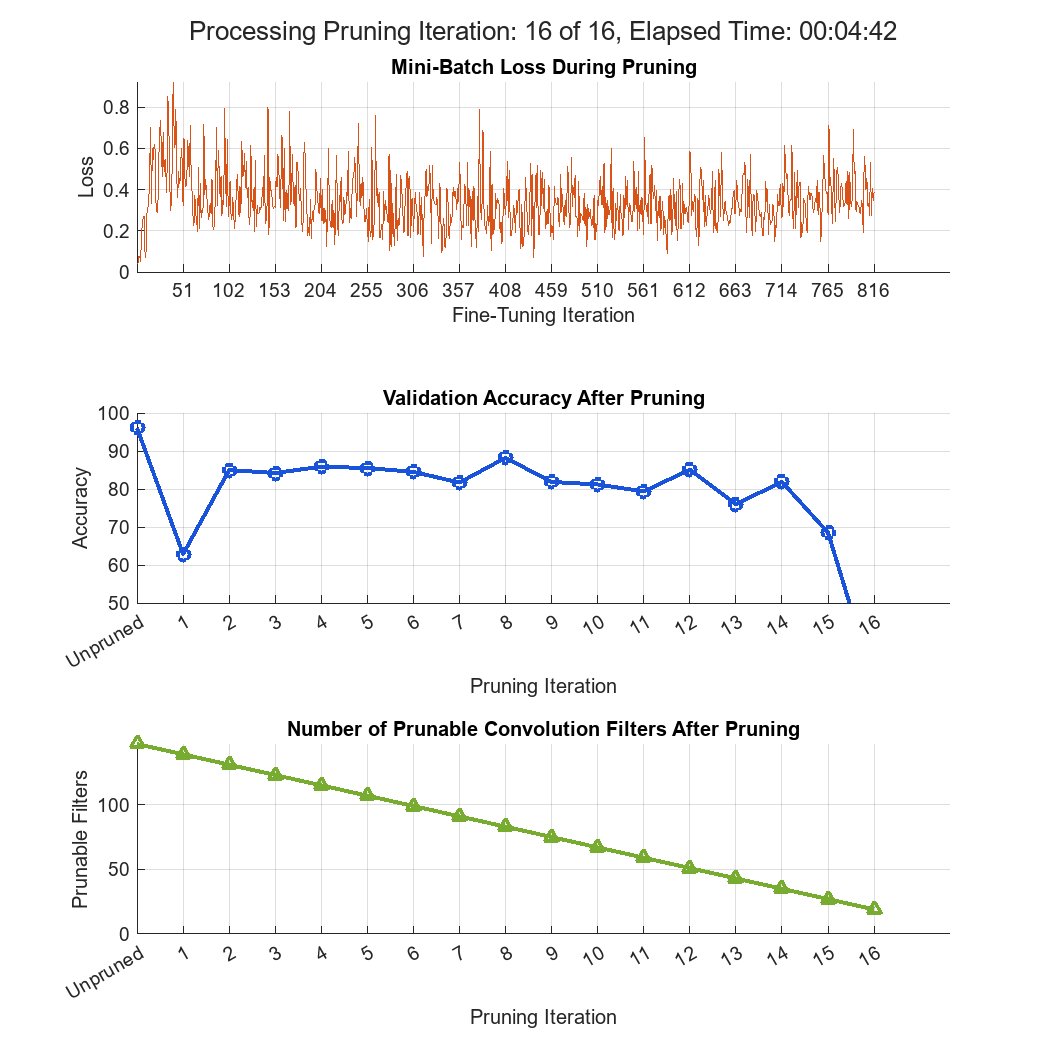

- Prune Image Classification Network Using Taylor Scores

Reduce the size of a deep neural network using Taylor pruning.

- Prune Filters in a Detection Network Using Taylor Scores

Reduce network size and increase inference speed by pruning convolutional filters in a you only look once (YOLO) v3 object detection network.