사영

주성분 분석(PCA)을 사용하여 신경망 계층 사영, 학습 가능한 파라미터 개수 줄이기

훈련 데이터를 대표하는 데이터 세트를 사용하여 계층 활성화 부분에 주성분 분석(PCA)을 수행하여 계층을 사영하고, 계층의 학습 가능한 파라미터에 선형 사영을 적용합니다. 라이브러리가 없는 C/C++ 코드 생성을 사용하여 임베디드 하드웨어에 신경망을 배포하는 경우에는 사영된 심층 신경망을 순방향 통과시키는 것이 일반적으로 더 빠릅니다.

Deep Learning Toolbox™ Model Compression Library에서 사용 가능한 압축 기법에 대한 자세한 개요는 Reduce Memory Footprint of Deep Neural Networks 항목을 참조하십시오.

함수

compressNetworkUsingProjection | Compress neural network using projection (R2022b 이후) |

neuronPCA | Principal component analysis of neuron activations (R2022b 이후) |

unpackProjectedLayers | Unpack projected layers of neural network (R2023b 이후) |

ProjectedLayer | Compressed neural network layer using projection (R2023b 이후) |

gruProjectedLayer | Gated recurrent unit (GRU) projected layer for recurrent neural network (RNN) (R2023b 이후) |

lstmProjectedLayer | Long short-term memory (LSTM) projected layer for recurrent neural network (RNN) (R2022b 이후) |

도움말 항목

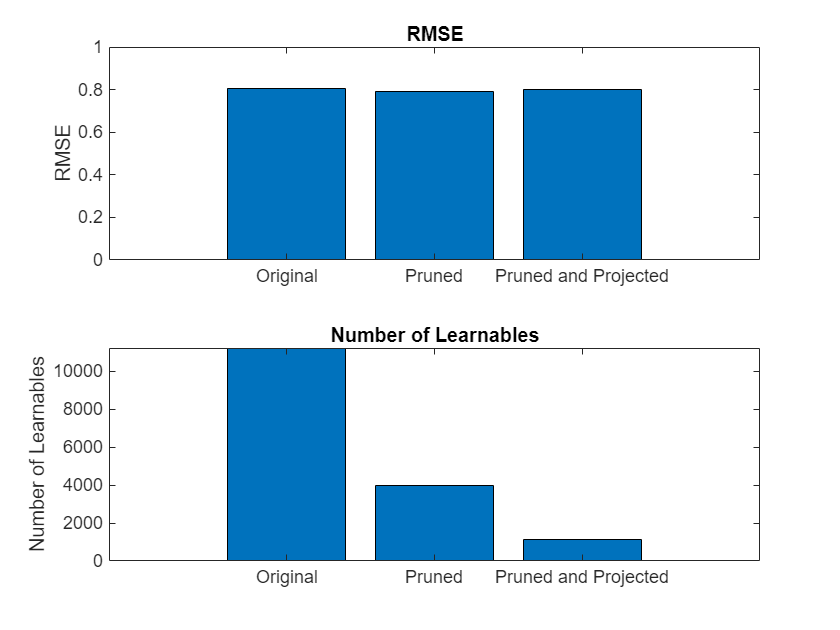

- Compress Neural Network Using Projection

Compress a neural network using projection and principal component analysis (PCA).

- Train Smaller Neural Network Using Knowledge Distillation

Reduce the memory footprint of a deep neural network using knowledge distillation. (R2023b 이후)