bagOfNGrams

Bag-of-n-grams 모델

설명

bag-of-n-grams 모델은 각 n-gram이 문서 모음의 각 문서에서 나타나는 횟수를 기록합니다. n-gram은 연속된 n개 단어의 모음입니다.

bagOfNgrams는 텍스트를 단어로 분할하지 않습니다. 토큰화된 문서로 구성된 배열을 만들려면 tokenizedDocument 항목을 참조하십시오.

생성

구문

설명

bag = bagOfNgrams

bag = bagOfNgrams(uniqueNgrams,counts)uniqueNgrams의 n-gram과 counts의 해당 빈도 수를 사용하여 bag-of-n-grams 모델을 만듭니다. uniqueNgrams에 <missing> 값이 있으면 counts의 해당 값은 무시됩니다.

입력 인수

속성

객체 함수

encode | 문서를 단어 개수 또는 n-gram 개수로 구성된 행렬로 인코딩 |

tfidf | TF-IDF(단어 빈도-역 문서 빈도) 행렬 |

topkngrams | 빈도가 가장 높은 n-gram |

addDocument | bag-of-words 모델 또는 bag-of-n-grams 모델에 문서 추가 |

removeDocument | bag-of-words 모델 또는 bag-of-n-grams 모델에서 문서 제거 |

removeEmptyDocuments | 토큰화된 문서 배열, bag-of-words 모델 또는 bag-of-n-grams 모델에서 빈 문서 제거 |

removeNgrams | bag-of-n-grams 모델에서 n-gram 제거 |

removeInfrequentNgrams | bag-of-n-grams 모델에서 낮은 빈도로 나오는 n-gram 제거 |

join | Combine multiple bag-of-words or bag-of-n-grams models |

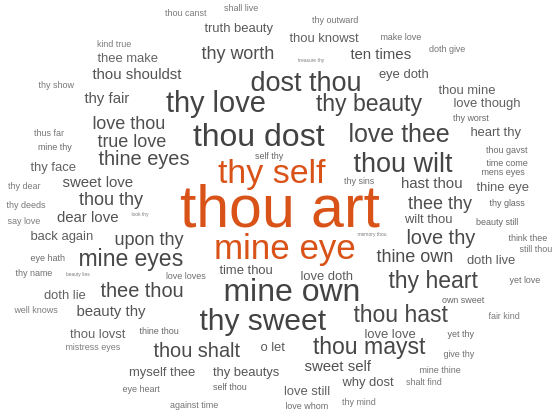

wordcloud | 텍스트, bag-of-words 모델, bag-of-n-grams 모델 또는 LDA 모델에서 워드 클라우드 차트 만들기 |

예제

버전 내역

R2018a에 개발됨

참고 항목

bagOfWords | addDocument | removeDocument | removeInfrequentNgrams | removeNgrams | removeEmptyDocuments | topkngrams | encode | tfidf | tokenizedDocument