GPU 알고리즘 가속

코드 실행 속도를 높이기 위해 컴퓨터의 GPU를 사용해 볼 수 있습니다. 사용하려는 모든 함수가 GPU에서 지원되는 경우 gpuArray 함수를 사용하여 입력 데이터를 GPU에 전달하고 gather 함수를 호출하여 GPU에서 출력 데이터를 가져올 수 있습니다. 딥러닝의 경우 MATLAB®은 다중 GPU에 대한 자동 병렬 연산을 지원합니다. GPU 지원을 사용하려면 Parallel Computing Toolbox™가 필요합니다.

GPU 배열을 받는 함수 목록은 함수 목록(GPU 배열)을 참조하십시오.

도움말 항목

- GPU에서 MATLAB 함수 실행하기 (Parallel Computing Toolbox)

GPU에서 함수를 자동으로 실행할 수 있도록

gpuArray인수를 제공합니다. - GPU 연산 요구 사항 (Parallel Computing Toolbox)

NVIDIA® GPU 아키텍처 지원.

- Run MATLAB Functions on Multiple GPUs (Parallel Computing Toolbox)

This example shows how to run MATLAB® code on multiple GPUs in parallel, first on your local machine, then scaling up to a cluster.

- 복수의 GPU에서 MATLAB을 사용한 딥러닝 (Deep Learning Toolbox)

로컬 또는 클라우드에 있는 복수의 GPU를 사용하여 심층 신경망 훈련 속도를 높입니다.

- Pedestrian and Bicyclist Classification Using Deep Learning (Radar Toolbox)

Classify pedestrians and bicyclists based on their micro-Doppler characteristics using deep learning and time-frequency analysis. (R2021a 이후)

- GPU Acceleration of Scalograms for Deep Learning (Wavelet Toolbox)

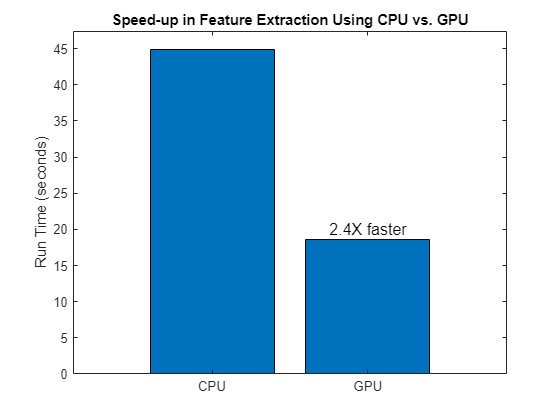

Use your GPU to accelerate feature extraction for signal classification.